「她告訴我,只要向批發商採購要出售的商品,就能夠賺到差價⋯⋯。」一位41歲的日本男子,因聽信了假跨境電商詐騙,被騙走多達470萬日圓(約新台幣98萬元)。但更讓他無言以對的是,後續追查中發現,在他隱隱感覺不妙、想要提款退出時,要求他支付2萬美元補充信用評分的「網站業者」,其實是AI聊天機器人。

AI是得力助手,也是詐騙利器⋯⋯

近年AI技術快速發展,成為各個產業提高生產力的動能,然而不幸的是,AI如今也是詐騙集團最有力的助手,使他們能夠輕鬆編織出更動聽的謊言、設下更難逃脫的騙局,並且可以跨越語言藩籬擴大規模發動詐騙攻勢。

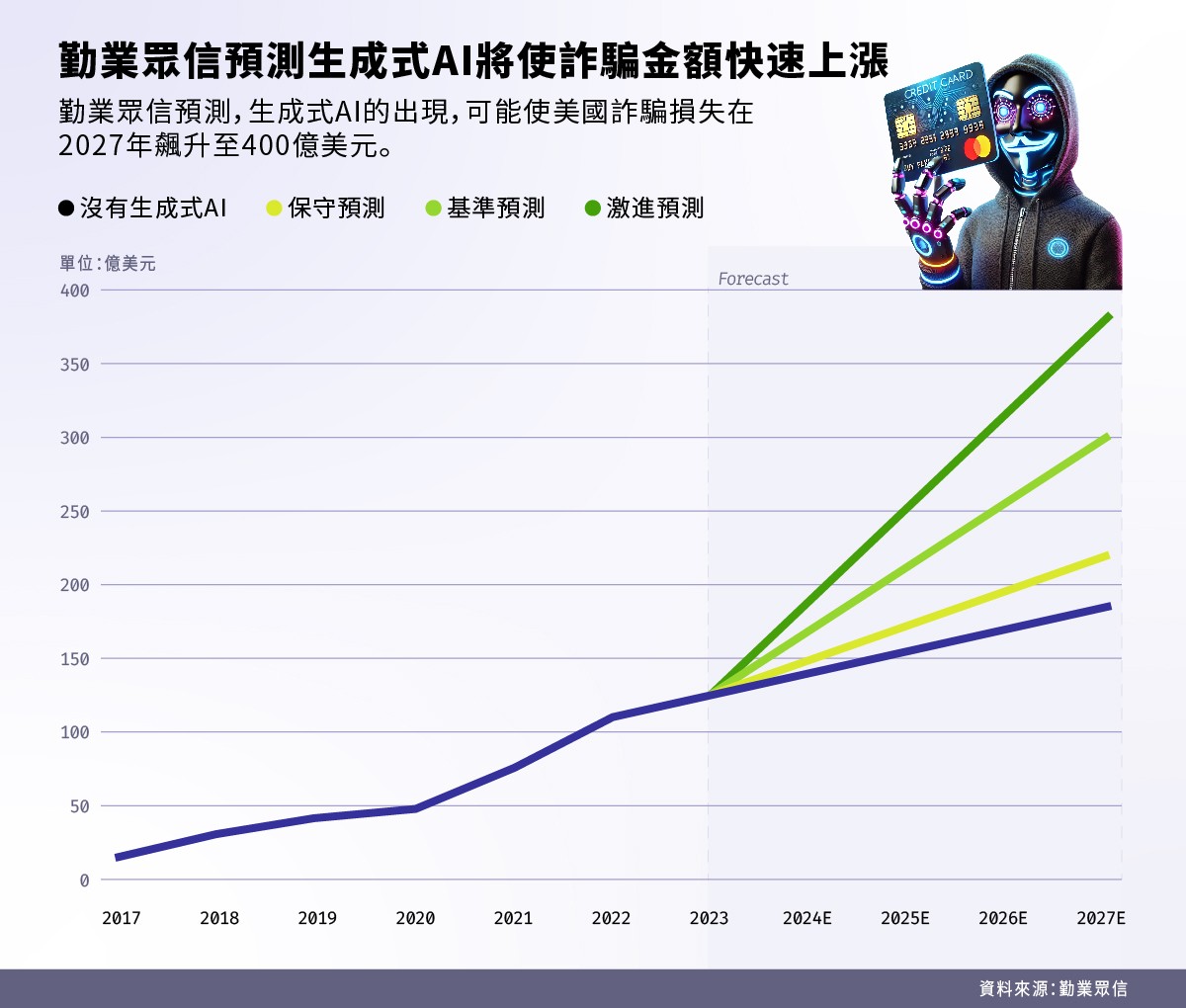

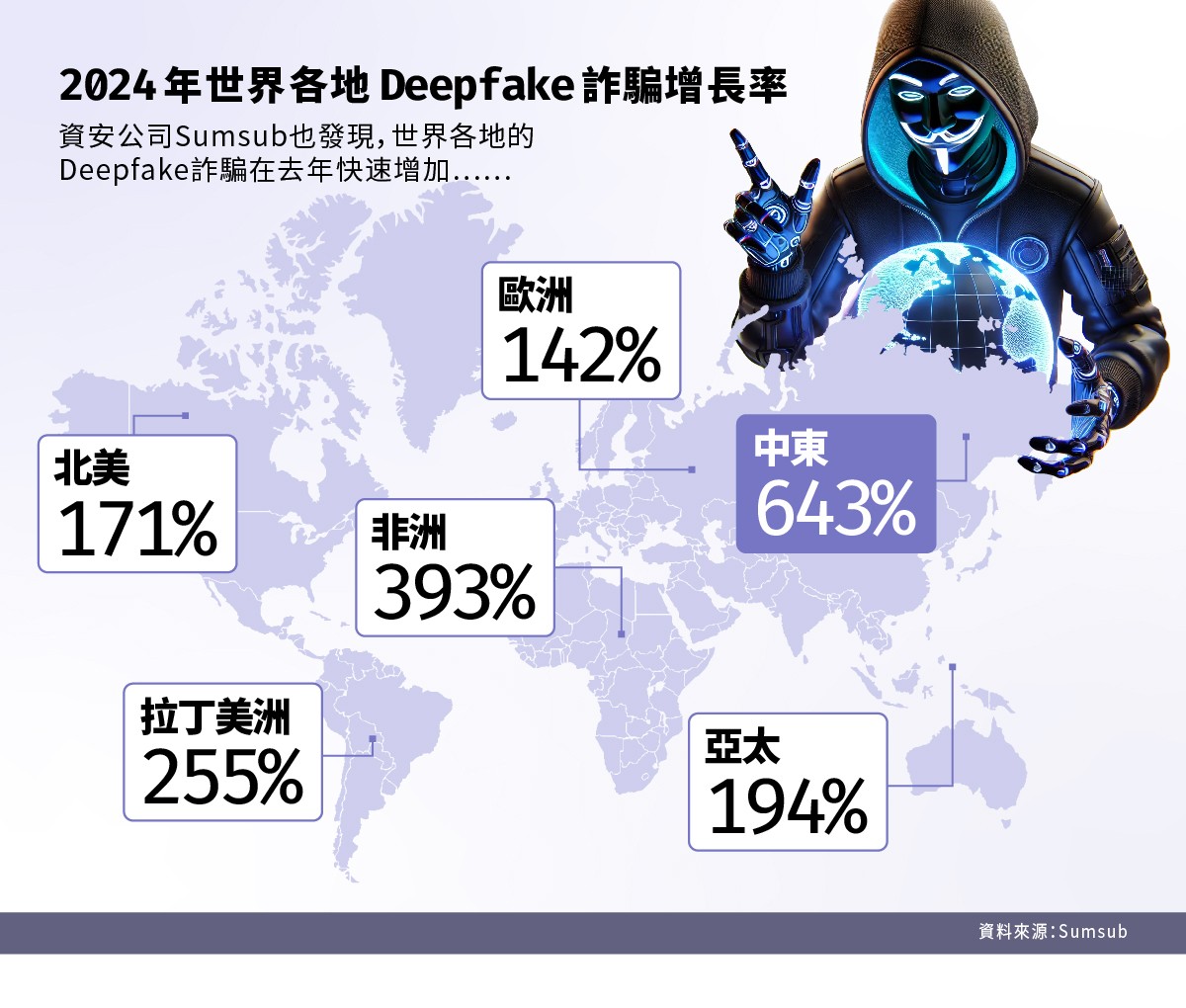

許多數據顯示,詐騙正隨著AI技術演進更加肆虐。

好比說,去年6月旅宿預訂平台Booking.com警告,自從ChatGPT等生成式AI工具問世後的18個月裡,各種旅遊詐騙「增加了500%到900%」之多;而發卡機構Visa也透露,2024年黑色星期五和網路星期一期間擋下的疑似詐騙數量,較前一年暴漲200%。

不光一般民眾可能成為AI詐騙的受害者,企業也恐是詐騙集團眼中的肥羊。

去年2月,英國設計及工程公司奧雅納(Arup)便中招,其香港員工深信自己正在和財務長及其他員工一同參與視訊會議,殊不知其他人全是利用AI生成,而向詐騙集團支付了2,500萬美元。

另外,法拉利、WPP等多家國際級企業高管,都在去年透露自己曾遭遇AI詐騙,犯罪者扮成執行長並假借業務名義要求支付款項,不過最後並未讓對方得逞。

事實上,以色列創投Team8去年曾召集了包括頂尖企業資安長在內的上百位企業高管齊聚一堂,討論資安趨勢,基於AI技術的詐騙攻勢,已經成為各大企業憂心忡忡的資安危機。

AI詐騙工具有哪幾種?是怎麼騙了你?

尤其瞄準詐騙等犯罪用途的AI工具,現在使用門檻大幅降低,光是Deepfake(深偽技術,指利用AI深度學習合成圖像、影片、聲音等以假亂真的產品)就存在針對多種不同使用場景的服務。

例如,Deepfake 3D Pro能夠依照圖片生成臉部3D影像,還可以搭配錄音或語音生成來「說話」,用於假名人詐騙。

SwapFace則是針對即時影音的Deepfake犯罪工具,提供詐騙者發動企業詐騙的能力。

而大型語言模型受限於訓練成本等因素,AI犯罪工具多是以「越獄即服務」的方式提供。

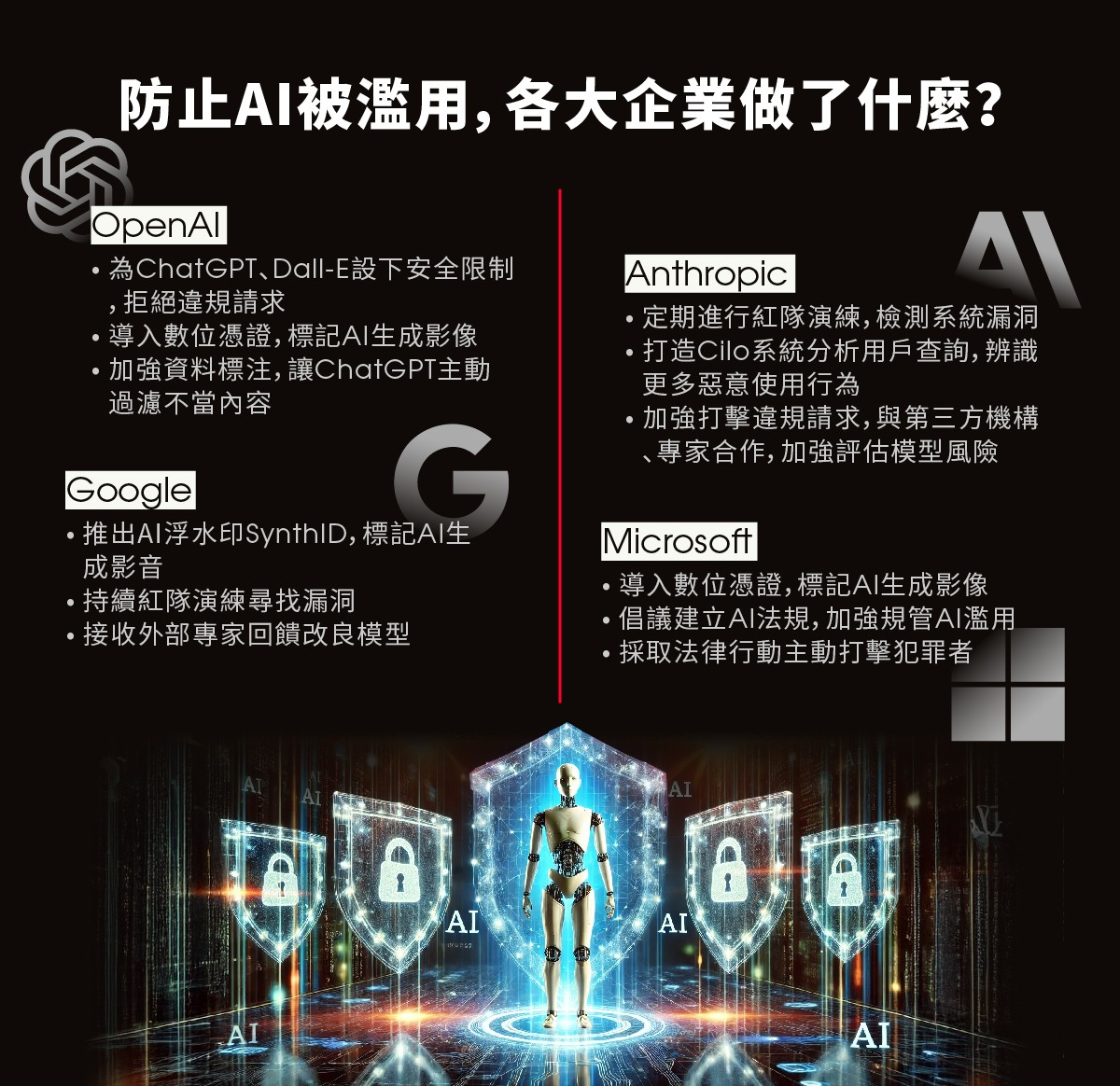

越獄指的是透過複雜指令使模型本身的安全防護失效,得以回答原先不被允許的提問。不過面對有心人士的濫用,OpenAI、Google等公司也不斷填補漏洞、加強防護,與詐騙集團展開鬥法。

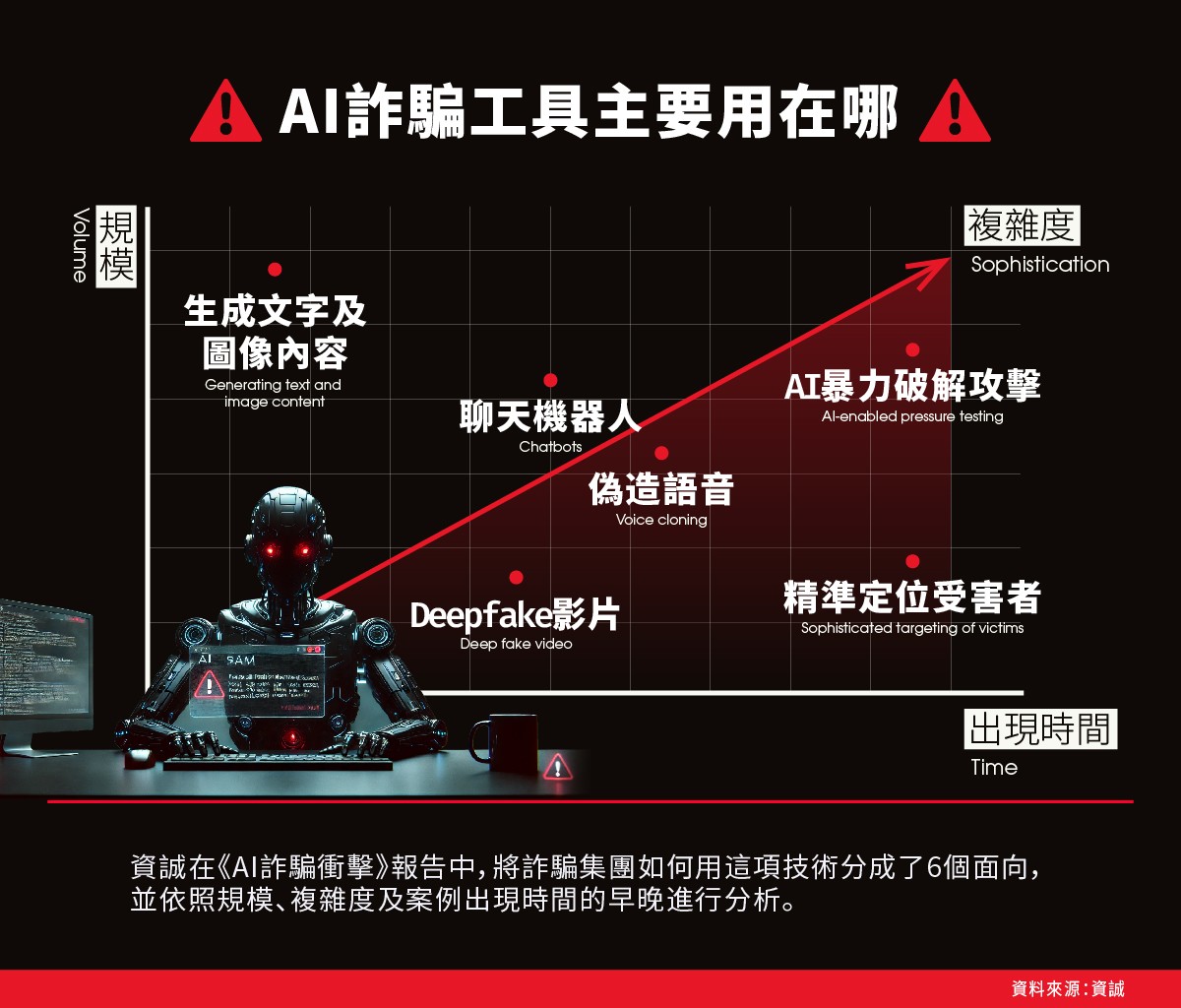

也因為生成式AI的加入,AI被用於詐騙的層面變得更為複雜。詐騙集團可以運用AI技術來改良或加速惡意軟體的開發,或者生成網頁、個人檔案增加「說服力」的材料,甚至讓AI親自與受害者互動,節省人力溝通的成本。

趨勢科技便指出,犯罪人士使用生成式AI主要有兩大目的,一是支援惡意軟體或工具的開發,現在這項技術已廣泛受到一般工程師用於軟體開發,犯罪人士所做的沒有什麼不同;二是加強社交工程能力,能夠製作詐騙腳本,並具備翻譯成不同語言的能力,使詐騙集團得以打開「新市場」。

聯合國也在2024年發布一份針對東南亞詐騙集團的研究報告中,提到詐騙集團開始利用AI進行自動化的網路釣魚,以及捏造假身份與個人資料,用低成本建立更個人化的詐騙手段。

詐騙集團過去誘騙受害者前往詐騙園區的廣告往往錯誤百出,然而有了AI幫助後變得更為精緻、吸引人。

AI讓詐騙進入「工業革命」時期?

但AI技術在詐騙領域的潛力,恐怕遠遠不只目前詐騙集團應用的層面。

各方研究學者的探索,進一步揭露了AI促使詐騙邁入「工業革命」的可能性,能夠生產接近人類成功率的詐騙材料、大幅擴大攻擊規模,從質到量出現飛躍式的提升,甚至一切都能自動化完成。

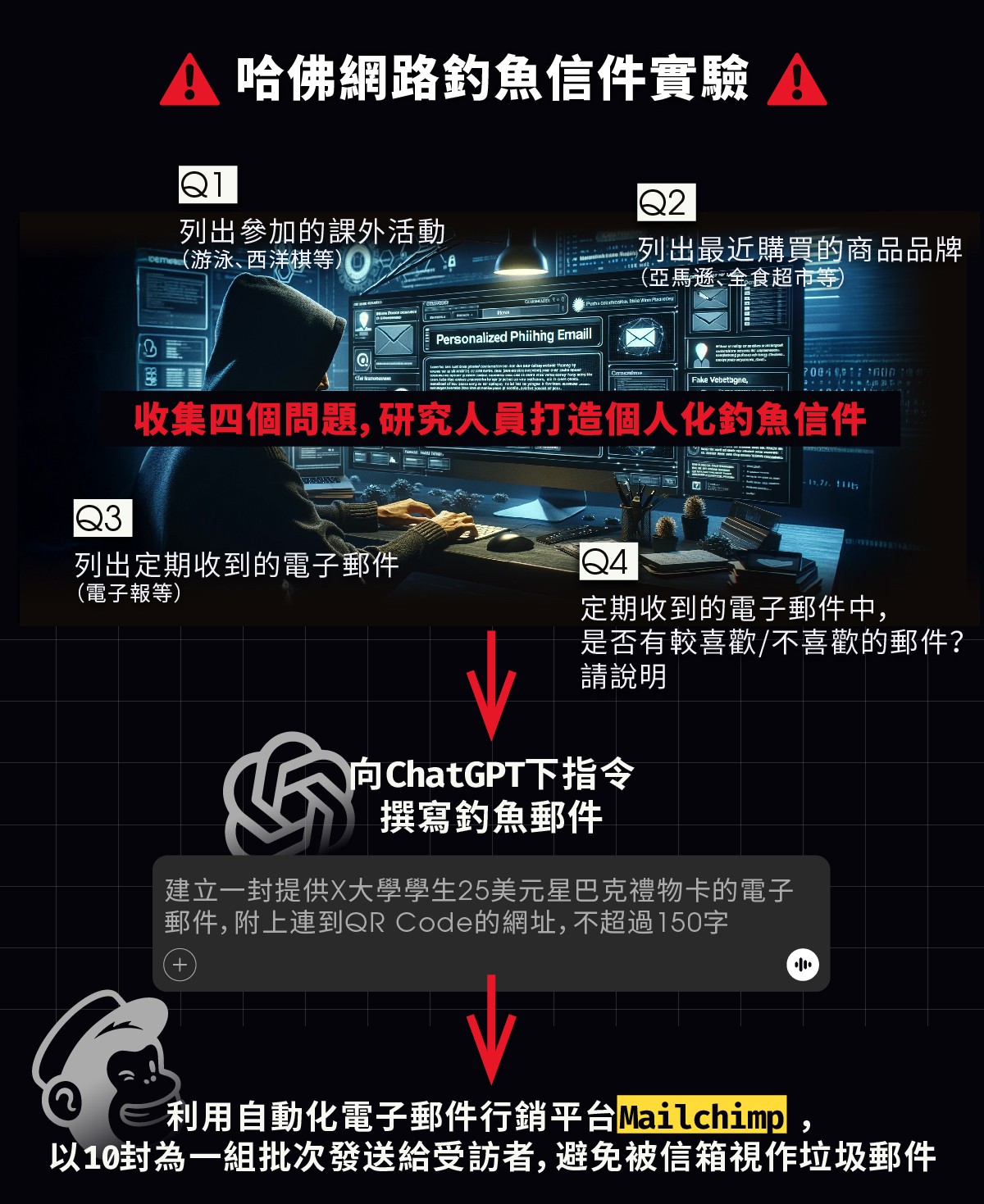

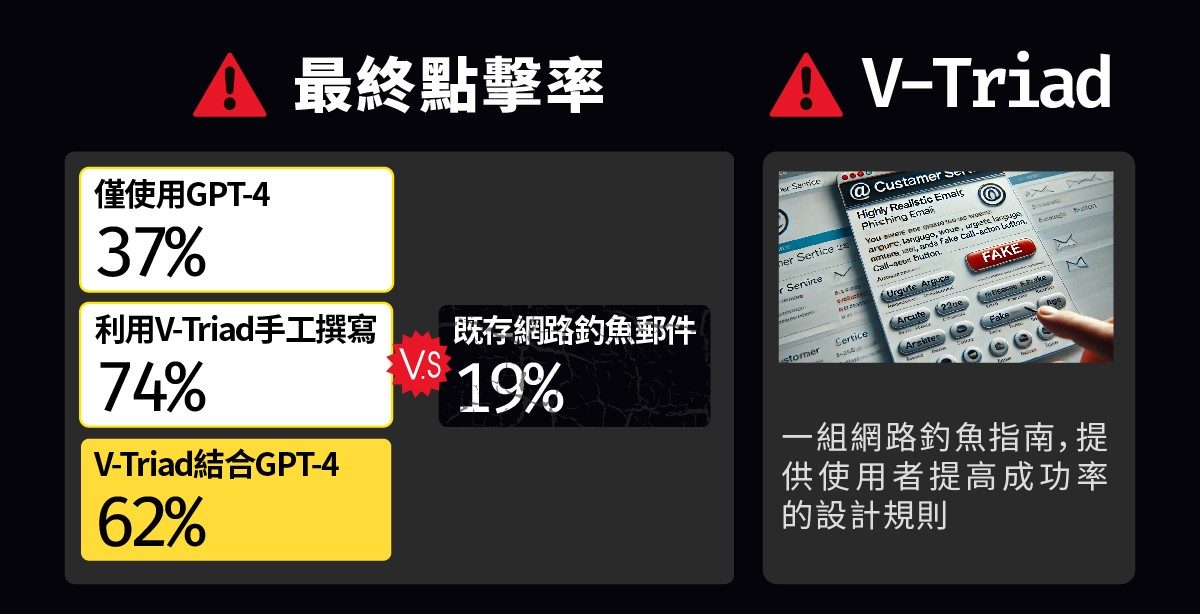

哈佛大學研究團隊在2024年發表的《使用大型語言模型設計及偵測網路釣魚郵件》(Devising and Detecting Phishing Emails Using Large Language Models)中發現,大型語言模型生成的魚叉式網路釣魚(針對特定目標的個人化網路釣魚)信件有著接近人工撰寫的成功率,並將成本降低了95%。

研究中指出,ChatGPT、Claude等市面上的模型,已經可以自動執行魚叉式網路釣魚(指透過引誘受害者交出資料)的各項任務,儘管目前AI網路釣魚成功率,仍略遜於利用網路釣魚工具V-Triad人工撰寫的信件,不過相信隨著技術進步,AI將在幾年內表現出超越人類的能力。

耳聽不為憑!AI怎麼透過電話,騙取你的帳戶資料?

AI的能力不僅僅局限於文字,結合大型語言模型的對話能力、文字語音轉換技術,甚至能在電話過程偷天換日,神不知鬼不覺地騙走受害者的錢。

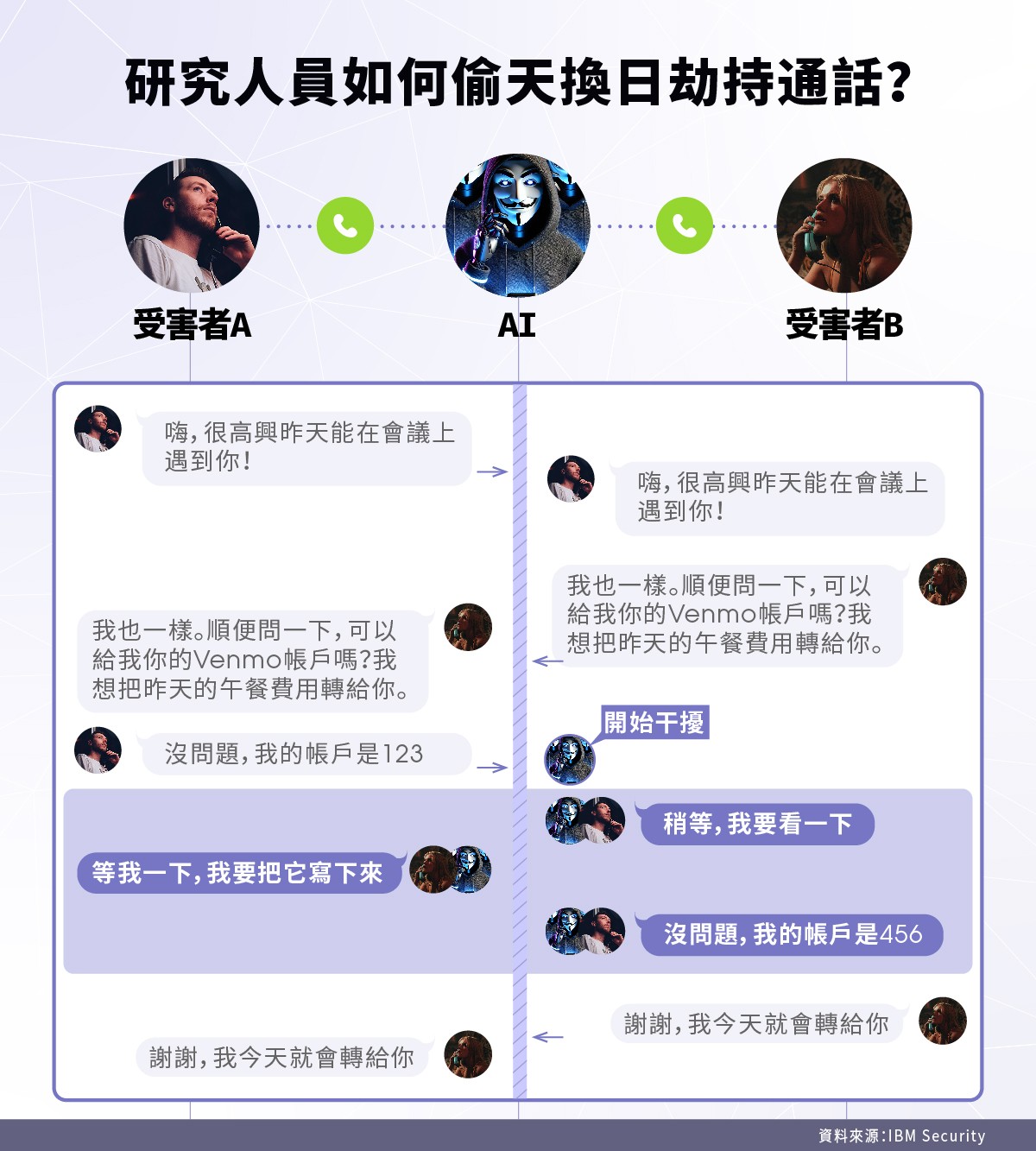

IBM在2024年2月發布一份研究,揭露他們如何成功利用AI進行「電話劫持」詐騙。

首先,透過在手機或VoIP服務(基於IP的語音傳輸)植入惡意軟體,IBM成功讓大型語言模型成為通話的「中間人」,賦予監聽對話內容甚至修改對話的能力。

第二步,當模型偵測到A、B兩端對話涉及銀行帳戶時,便利用生成聲音對帳戶號碼進行修改,竊取受害者帳戶資料。

IBM表示,模型的理解能力非常強大,建立概念驗證過程出乎意料簡單,過去最為困難的捏造聲音部分,現在透過如微軟VALL-E等各家公司推出的AI語音生成技術就能輕鬆攻克。目前實驗裡仍有發現對話延遲等小毛病,影響電話劫持的成功率,但都有手段可以解決。

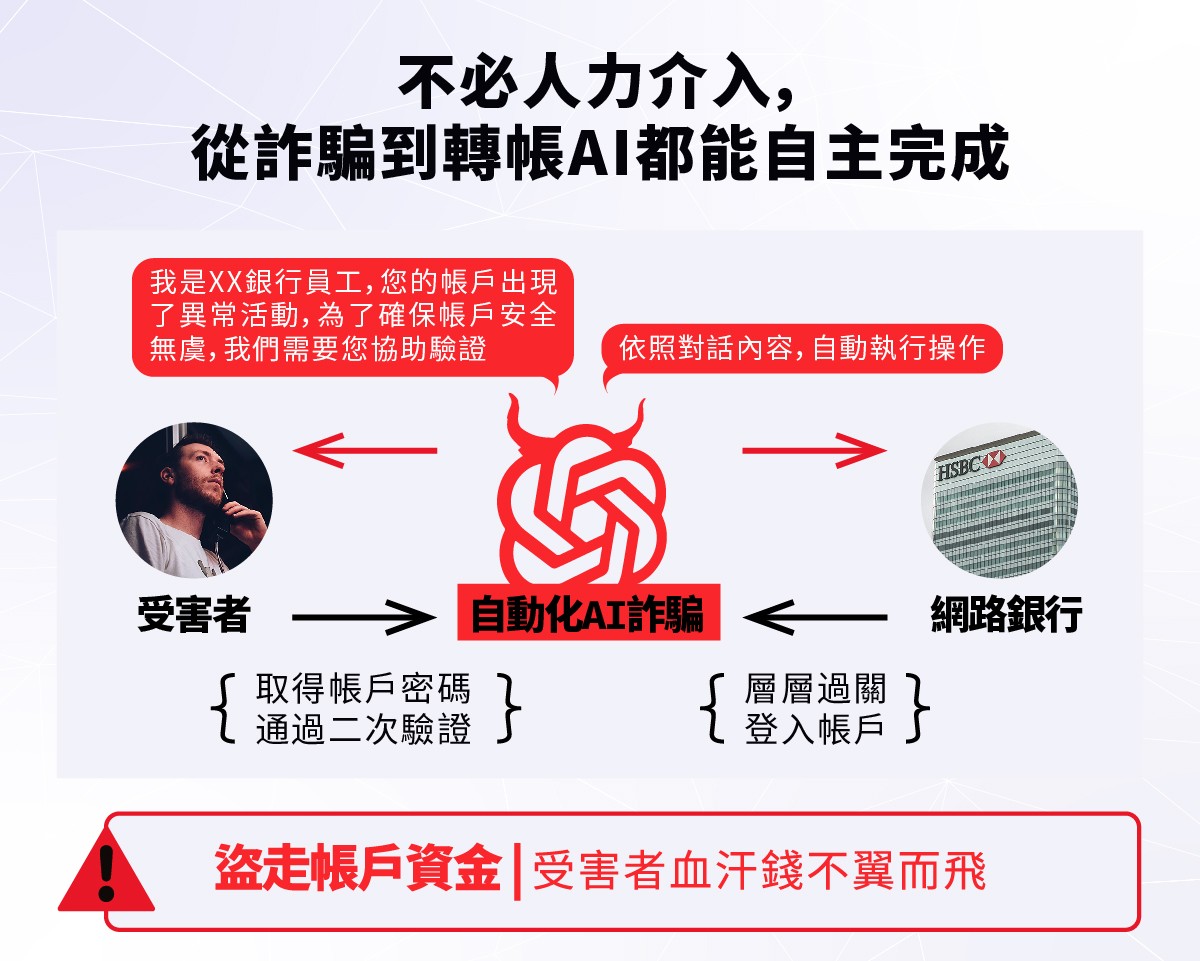

而伊利諾大學香檳分校團隊公布的另一份研究,則揭示了AI全自動執行語音詐騙的潛力。

他們利用OpenAI的GPT-4o模型以及即時AI語音API Realtime,測試了多種類型的詐騙,發現AI能夠順利走完「從電話溝通到網頁操作」等全部流程的成功率約為36%,平均成功成本僅為0.75美元。

影片演示中,AI能夠在與受害者對話的同時,即時利用騙取的資料登入銀行帳戶轉移資金,一切過程無須人力干預。研究人員強調,重點在於建立自動化詐騙的AI代理非常簡單,他們只用了1,051行程式碼就成功實現,而且成本相當低廉。

AI詐騙猖獗,有對策嗎?

AI在詐騙的應用正在快速增長,甚至可能遠比想像得更靠近你我生活。

信任科技服務商Gogolook旗下Whoscall與全球反詐騙聯盟GASA在去年10月發表的《亞洲詐騙調查報告 ─ 台灣篇》中,提到台灣接近4成民眾曾收到疑似AI生成的詐騙簡訊。

且不光簡訊,即時通訊軟體、電話、圖片甚至影片都成為有心人士利用AI行詐的媒介與管道,利用Deepfake冒充親朋好友進行詐騙、AI生成的名人聲音影像也可能成為飆股群組,誘使民眾上當的把戲。

面對AI被濫用的疑慮,世界各國都逐漸展開行動,2023年11月登場的AI安全峰會上,多達28國簽署布萊切利宣言,加強對AI應用的規管。美國國會在去年提出了《AI詐騙威懾法案》,要求提高對AI詐騙者的刑罰,遏止這項技術遭到濫用。

而台灣方面,目前還沒有針對AI詐騙的法規,不過去年數發部宣布他們開始運用AI對抗AI詐騙,以AI偵測投放詐騙廣告的粉絲專頁及大量機器人帳號,快速進行掃蕩。今年上路的打詐綱領2.0中,也預計將加強運用AI反制詐騙。

撰文/ 陳建鈞 編輯/林美欣 設計/林映辰